Collaboration IA entre Silicon Valley et Pentagone : enjeux & contrats

Dans un contexte mondial marqué par une instabilité géopolitique croissante, la convergence entre le secteur technologique et le domaine militaire américain s’accélère. Des entreprises telles qu’OpenAI, Google, Meta et Palantir intensifient leur collaboration avec le Pentagone, marquant un tournant stratégique majeur dans l’histoire de l’intelligence artificielle (IA) appliquée à la sécurité nationale. L’évolution de cette alliance, appuyée par des investissements records et des initiatives gouvernementales ambitieuses, soulève des questions éthiques, politiques et environnementales d’une portée inédite.

Une coopération renforcée entre les géants de la tech et l’armée américaine

Sous l’impulsion de l’administration Trump puis de ses successeurs, les États-Unis ont significativement augmenté leurs dépenses de défense, avec un budget dépassant les 850 milliards de dollars pour 2025. Cette enveloppe financière colossale a permis de multiplier les partenariats public-privé, notamment dans les domaines de la cybersécurité, de la reconnaissance automatisée, des systèmes autonomes et des plateformes d’IA militaire.

Parmi les projets phares, OpenAI a récemment décroché un contrat estimé à 200 millions de dollars pour développer des prototypes d’intelligence artificielle à usage militaire et administratif. Cette annonce intervient après plusieurs années où OpenAI s’était tenu à l’écart des applications militaires, invoquant des principes éthiques. Le revirement marque un réalignement stratégique, motivé par des considérations de sécurité nationale, mais aussi par la nécessité de financer des modèles d’IA de plus en plus coûteux.

Le détachement 201 : quand les ingénieurs tech deviennent officiers

Autre fait marquant de cette collaboration renforcée : la création d’une unité spéciale baptisée Detachment 201 au sein de la réserve de l’armée de l’air américaine. Cette unité intègre directement des cadres de haut niveau issus de la Silicon Valley – dont plusieurs ingénieurs et dirigeants de Meta, Palantir et OpenAI – nommés au grade de lieutenant-colonel.

Ce mouvement vise à institutionnaliser la présence d’experts civils dans les sphères militaires, leur donnant à la fois un rôle décisionnel stratégique et un accès à des données classifiées. En intégrant la hiérarchie militaire, ces personnalités de la tech deviennent des vecteurs directs de l’innovation dans les opérations de défense, consolidant ainsi le lien entre technologies émergentes et tactiques militaires avancées.

Le pivot militaire de la Silicon Valley : un revirement historique

Historiquement, plusieurs entreprises de la tech, à commencer par Google, avaient adopté des politiques de neutralité vis-à-vis des applications militaires. Le retrait de Google du controversé Project Maven en 2018, suite à une levée de boucliers de ses employés, semblait alors marquer une ligne rouge éthique dans le domaine de l’IA.

Aujourd’hui, cette posture semble largement révolue. La complexité et le coût de développement des modèles d’intelligence artificielle actuels (notamment les LLM – Large Language Models) rendent leur financement dépendant de partenariats massifs, y compris avec l’État. En retour, le gouvernement américain voit dans ces outils une opportunité stratégique pour maintenir sa supériorité technologique face à la Chine et à la Russie.

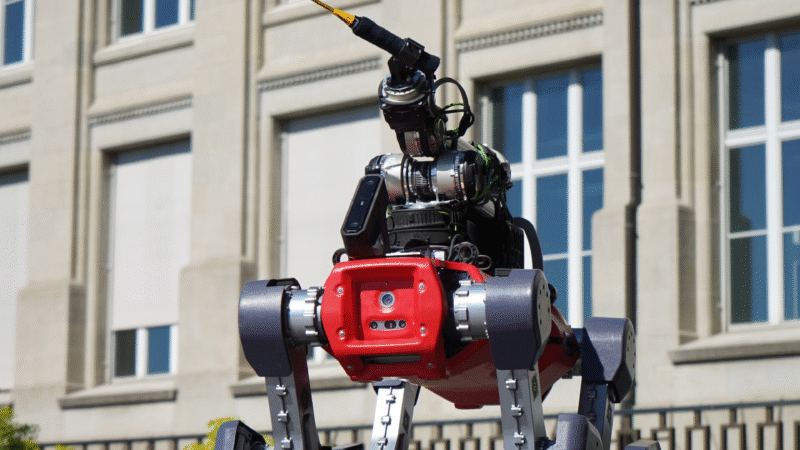

Technologies duales : de la consommation au champ de bataille

La plupart des innovations déployées dans le cadre de ces collaborations sont issues de technologies initialement conçues pour le grand public : agents conversationnels, modèles de vision par ordinateur, systèmes de recommandation, etc. Ces outils trouvent aujourd’hui des usages militaires concrets : aide à la décision en situation de crise, surveillance automatisée, traitement de renseignements, gestion logistique prédictive ou encore simulation stratégique.

Cette logique de « double usage » pose des enjeux cruciaux :

- Éthiques, en brouillant la frontière entre usages civils et militaires ;

- Juridico-politiques, concernant la gouvernance, les droits fondamentaux et les mécanismes de contrôle ;

- Sociétaux, puisque les utilisateurs grand public alimentent (involontairement) l’évolution de technologies pouvant être militarisées.

Une course technologique mondialisée : les ambitions chinoises

Sur la scène internationale, les États-Unis ne sont pas seuls à accélérer l’intégration de l’IA dans leur doctrine militaire. La Chine, via l’entreprise Zhipu AI, multiplie les efforts pour imposer ses modèles auprès des pays en développement. L’objectif est clair : créer un écosystème alternatif d’intelligence artificielle, moins dépendant des standards occidentaux, et potentiellement aligné avec les intérêts stratégiques chinois.

Cette compétition technologique prend une dimension idéologique. OpenAI a récemment alerté sur des tentatives d’influence chinoises via des offres de modèles open source déployés dans des infrastructures partenaires à l’étranger. Derrière cette stratégie se profile un affrontement pour la souveraineté numérique globale.

Adoption massive de l’IA au quotidien : un facteur d’accélération

Au-delà du volet militaire, l’adoption de l’intelligence artificielle progresse dans tous les secteurs de la société. Selon une étude relayée par Axios, 1 travailleur sur 8 utilise l’IA chaque mois dans son activité professionnelle. Cette généralisation rapide accroît la pression sur les entreprises pour innover, tout en rendant les modèles d’IA toujours plus puissants, plus coûteux à entraîner et plus gourmands en énergie.

Le cycle de développement s’est accéléré : il ne s’écoule plus que quelques mois entre deux générations de modèles, ce qui alimente la course à la performance… et au financement. C’est dans ce contexte que les contrats publics – y compris militaires – deviennent un levier essentiel pour soutenir les avancées technologiques.

Des enjeux juridiques et environnementaux émergents

En parallèle de ces évolutions géostratégiques, plusieurs questions de fond apparaissent.

Le flou juridique autour des droits d’auteur

La question du copyright appliqué à l’IA est au cœur d’un débat juridique complexe. Si certaines juridictions ont récemment reconnu un succès partiel pour les artistes et les auteurs face aux générateurs d’images et de textes, le cadre légal reste lacunaire. Or, dans un contexte où les modèles sont utilisés pour l’entraînement d’applications militaires, la question des droits associés à leurs contenus prend une dimension nouvelle, potentiellement sensible.

L’impact environnemental des centres de données

Les centres de données nécessaires à l’entraînement et à l’utilisation de l’IA représentent une empreinte carbone de plus en plus préoccupante. Une étude récente souligne l’impact énergétique massif des infrastructures IA, qui consomment plusieurs centaines de mégawatts par site. Si l’armée américaine adopte massivement ces technologies, la pression sur les ressources énergétiques risque de s’accentuer – un paradoxe, alors même que la transition écologique constitue une priorité nationale.

Vers une doctrine d’IA militaire intégrée

Face à cette conjoncture, le Pentagone ne se contente plus de collaborations ponctuelles : il développe une doctrine d’intégration de l’IA à long terme, articulée autour de trois axes principaux :

- Institutionnalisation des compétences technologiques : via l’intégration des cadres civils dans des unités militaires actives ;

- Structuration industrielle : en finançant massivement les entreprises clés de la Silicon Valley pour garantir leur viabilité et leur alignement stratégique ;

- Standardisation des usages : avec des modèles d’IA calibrés pour être interopérables entre les différentes branches des forces armées et les agences fédérales.

En conclusion : vers une nouvelle ère de l’intelligence artificielle géopolitique

Le virage stratégique que représente l’implication directe d’OpenAI, Google, Meta et Palantir dans les programmes militaires américains redéfinit les contours du rôle de l’intelligence artificielle au XXIe siècle. Loin d’être cantonnée aux usages civils ou commerciaux, l’IA devient un instrument de puissance étatique, un outil de domination technologique et un levier de souveraineté nationale.

Mais ce tournant s’accompagne d’interrogations majeures : quid de la transparence, de la régulation, des droits civiques et des impacts climatiques ? Alors que les frontières entre privé et public, entre civil et militaire, s’estompent, il devient crucial de mettre en place des garde-fous éthiques et juridiques solides, à l’échelle nationale comme internationale.

Le monde entre ainsi dans une ère où la guerre cognitive, la diplomatie algorithmique et la stratégie numérique deviennent des réalités tangibles. Une époque où les lignes de front ne sont plus seulement physiques, mais aussi logicielles.